12 Phonetische Grundlagen

12.1 Die Disziplinen Phonetik und Phonologie

12.2.1 Messung und Visualisierung von Schallwellen

12.2.2 Frequenzen im Schallsignal

12.3 Auditive und Perzeptive Phonetik

12.4 Artikulatorische Phonetik

12.1 Die Disziplinen Phonetik und Phonologie

Phonetik und Phonologie besitzen in gewisser Weise eine Sonderstellung innerhalb der linguistischen Teildisziplinen. Die von den beiden Disziplinen untersuchten Einheiten sind zwar sprachlicher Natur, besitzen aber selbst keine Bedeutung: Sie dienen vielmehr „nur“ dazu, sprachliche Einheiten voneinander zu unterscheiden. Ausgehend von dem Phon, dem Laut, lassen sich Phonetik und Phonologie vereinfacht als „Wissenschaft(en) von den Lauten“ übersetzen. Diese Erfassung trifft das Untersuchungsgebiet der beiden Wissenschaften allerdings nur unzureichend; sie lassen sich eher als „Wissenschaft(en) vom sprachlichen Trägermaterial“ bestimmen.

Warum aber gibt es zwei Disziplinen, die sich damit beschäftigen? Ein Grund dafür liegt im Gegenstand, der zwei unterschiedliche Problemstellungen umfasst. Zum einen ist zu fragen, welche physikalischen Eigenschaften menschliche Sprache besitzt. Diese Perspektive wird von der Phonetik eingenommen. Als wissenschaftliche Disziplin hat sie sich seit Ende des 18. Jahrhunderts etabliert; ihre Entwicklung ist eng mit den technischen Möglichkeiten der Aufzeichnung von Ton verbunden. Bezugsdisziplinen der Phonetik sind neben der Sprachwissenschaft die Physik sowie die Biologie. Ihre Anwendungsinteressen betreffen oft praktische Fragen, z. B. der medizinischen Diagnostik, der Spracherkennung oder der Sprachsynthese ((T1) ![]() Text-to-Speech, vgl. Kap. 18).

Text-to-Speech, vgl. Kap. 18).

Demgegenüber versteht sich die Phonologie als eine geisteswissenschaftliche Disziplin. Sie interessiert sich für die Frage, welche der (von der Phonetik beschriebenen) physikalischen Mittel eine bedeutungsunterscheidende Funktion besitzen. Innerhalb des Fachs Phonetik wird die Phonologie auch als funktionale oder funktionelle Phonetik bezeichnet. Sie spielt eine entscheidende Rolle bei der Wahl der phonetischen Untersuchungsgegenstände. Aus der Perspektive der Phonologie betrachtet, ist die Phonetik eine wichtige Bezugsdisziplin, die dabei hilft, den Untersuchungsgegenstand ausgehend von verschiedenen Merkmalen zu erfassen.

Die theoretischen Beschreibungsansätze in beiden Disziplinen sind vielfältig. Einführend sei auf Wiese (2010), für die Phonetik auf Pompino-Marschall (2009), für die Phonologie auf Hall (2011) verwiesen.

12.2 Akustische Phonetik

Die physikalische Dimension des Sprachklangs wird durch die akustische Phonetik näher untersucht. Ihr Gegenstand ist das Schallsignal. Der Begriff ist von einer (metaphorischen) Verwendungsweise des Ausdrucks „Signal“ zu trennen, in der manchmal von einem „Sprachsignal“ gesprochen wird. Das Signal ist eine physikalisch messbare Größe, die mithilfe von Apparaten analysiert und in physikalischen Einheiten beschrieben werden kann. In seiner Signalqualität unterscheidet sich das Sprechen nicht von anderen Geräuschen, wie sie z. B. durch das Umwerfen eines Stuhls, einen Automotor oder Händeklatschen hervorgerufen werden.

Besonders interessant sind die bildgebenden Verfahren, die die Phonetik bereitstellt. Man spricht in diesem Zusammenhang von „visible speech“. Zur Analyse und Visualisierung von Schalleigenschaften stehen heutzutage leistungsfähige Computerprogramme zur Verfügung, z. B. „praat“.[ 1 ]

12.2.1 Messung und Visualisierung von Schallwellen

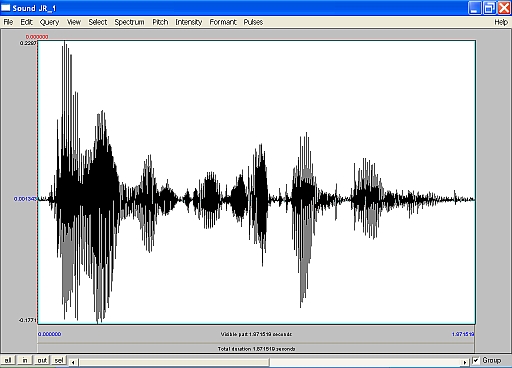

Durch Sprechen wird eine Serie von kleinen, schnellen Fluktuationen des Luftdrucks ausgelöst:[ 2 ] die Schallwelle. Bei der Aufnahme durch ein Mikrophon werden die Luftdruckveränderungen mittels einer Membran erfasst, deren zeitliche Verschiebung aus einer Ruhelage in elektrische Spannungen wechselnder Größe umgewandelt wird. Die akustischen Eigenschaften des aufgezeichneten Signals können in einem Oszillogramm sichtbar gemacht werden. Abb. 1 zeigt das Oszillogramm einer sprachlichen Äußerung.

Abb. 1: Oszillogramm (T2) „Anna sitzt im Zug nach Aachen.“

Die Amplitude, der Abstand zwischen Null-Linie und Maximum bzw. Minimum des Ausschlags, ist ein Maß für die Lautstärke, die in Dezibel (dB) erfasst wird. Je größer die Amplitude, umso „lauter“ [ 3 ] ist das Signal.

Mithilfe von Oszillogrammen können Lautproduktionen sichtbar gemacht werden. So kann das Schallsignal Auskunft darüber geben, ob z. B. ein Wort wie Arbeitsamt mit stimmhaftem oder stimmlosen s-Laut, mit oder ohne [t] ausgesprochen wird. Zudem lässt sich die Länge eines Lautes erfassen: Die Artikulation von [uː] im obigen Beispiel dauerte z. B. rund 70 Millisekunden (ms). Für das Deutsche sind Längenmessungen besonders im Hinblick auf die so genannten „Langvokale“ interessant.

12.2.2 Frequenzen im Schallsignal

Der Begriff „Frequenz“ bezieht sich auf die zyklische Struktur periodischer Wellen, wie sie bei Artikulation so genannter „stimmhafter Laute“, z. B. von Vokalen, produziert werden. Die Einheit „Hertz“ (Hz) erfasst die Anzahl der durchlaufenen Zyklen pro Sekunde. Wiederholt sich z. B. ein Zyklus in einer Sekunde 100-mal, so spricht man von einer Frequenz von 100 Hertz, bei einer 1.000-maligen Wiederholung von einer Frequenz von 1.000 Hertz. Hohe Frequenzen werden ohrenphonetisch als hellerer Klang eingestuft als tiefe Frequenzen. Der für Sprache relevante Frequenzbereich liegt zwischen 20 und 20.000 Hertz.

Sprachliche Äußerungen sind als Vielzahl von Frequenzen erfassbar, die sich schnell oder langsam verändern. Vergleichsweise langsame Veränderungen betreffen die vom Ohr wahrgenommene Tonhöhe des Sprechens (pitch). Physikalisch entspricht ihr die Grundfrequenz (F0) des Signals. Schwankungen der Grundfrequenz werden von menschlichen Hörern als „Sprechmelodie“ wahrgenommen (s. Kap. 14).

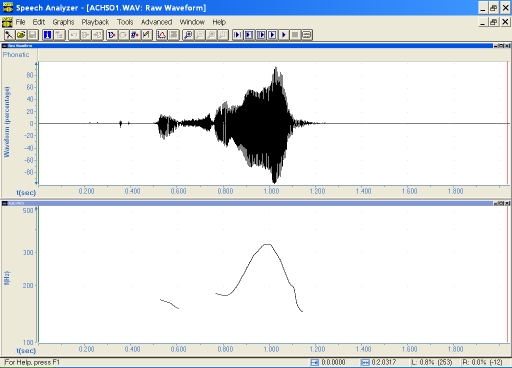

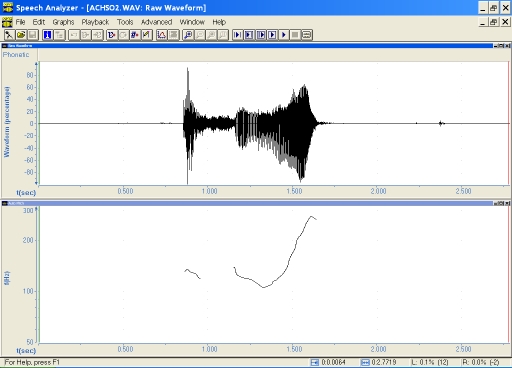

Abb. 2 und 3 zeigen den Grundfrequenzverlauf von verschiedenen Umsetzungen der Äußerung „ach so“. Im ersten Fall steigt die Frequenz an, um dann wieder abzufallen. Im zweiten Fall findet sich ein leichter Abfall, dann eine deutliche Steigung. Unterbrechungen der Konturen sind darauf zurückzuführen, dass stimmlose Laute keine periodischen Schwingungen aufweisen.

Abb. 2: (T3) „ach so!“

Abb. 3: (T4) „ach so?“

Die mittlere Sprechstimmlage eines Sprechers, die durch Messung der Grundfrequenz über einen längeren Äußerungszeitraum hinweg ermittelt wird, ist ein wichtiges Indiz für die Sprechererkennung. Eine Männerstimme im Deutschen liegt bei rund 120 Hz, eine Frauenstimme bei rund 230 Hz, die Stimme eines Säuglings um die 400 Hz.[ 4 ] Die Standardabweichung vom (individuellen) Grundfrequenzmittelwert ist ein Indiz für die wahrgenommene Melodik der Stimme.

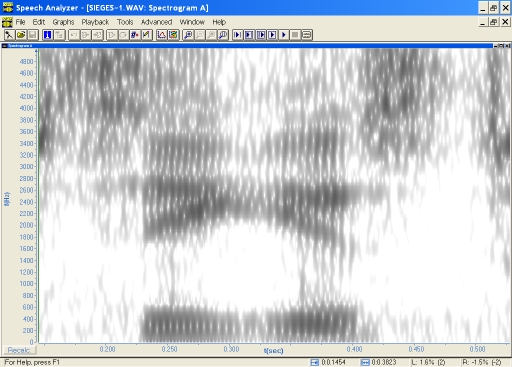

Sprachlaute entsprechen schnellen Frequenzveränderungen. Zudem umfassen sie – anders als so genannte „reine Töne“ (Sinuswellen) – verschiedene Frequenzbereiche, die man durch eine Spektralanalyse bestimmen und in einem Spektrogramm (auch als Sonagramm bezeichnet) visualisieren kann. Abb. 4 gibt ein Beispiel.

Abb. 4: Breitband-Spektrogramm [ziːgəst] („Am Siegestor“)

Die vertikalen Streifen im Spektrogramm lassen die Schwingungen der Stimmlippen erkennen, die für stimmhafte Laute kennzeichnend sind (s. Kap. 13.4). Die horizontalen Streifen in der Abbildung zeigen die Grundfrequenz (F0) sowie weitere ausgeprägte Frequenzen, die so genannten Formanten. Sie werden „von unten nach oben“ gezählt und sind ein wichtiges Indiz für die Klassifikation von Sprachlauten. Die Formanten lassen die Formung des Mundes bei der Lautproduktion erkennen, u. a. den Grad der Mund- bzw. Kieferöffnung (F1), der Zungenhebung (F2) sowie der Lippenrundung (F3).

Bei Sprachvergleichen können Messungen der Formantenkonstellationen als tertium comparationis dienen. Hakkarainen (1995, S. 126) stellt beispielsweise die Vokale des Deutschen und Finnischen auf diese Weise vergleichend dar. Die genauen physikalischen Messungen sind wichtig, da phonetische Transkriptionen oft einen einzelsprachlichen Bezug aufweisen (vgl. Kap. 13). Auch für „abweichende“ Lautrealisierungen, wie sie für den Fremdsprachenerwerb kennzeichnend sind, erweist sich ein messender Zugang als sinnvoll. Entsprechende Forschungen finden sich bislang allerdings noch selten.

Ausgehend von der Buchstabenschrift verbindet sich mit dem Ausdruck „Sprachlaut“ oft die Vorstellung einer statischen Einheit. Sprachlaute sind jedoch dynamische Größen, wobei sich der Ablauf der Muskelbewegung je nach Lautumgebung unterschiedlich gestaltet. So unterscheidet sich das [k] in Sack beispielsweise von dem [k] in Tick, ein [d] wie in du von einem [d] wie in die. Die Anpassungsprozesse von Lauten in einer Lautkette bezeichnet man als Koartikulation.

Als physikalische Erscheinungen sind keine zwei Laute jemals gleich. Auch von ein und demselben Sprecher produzierte Laute stellen sich bei Wiederholung als different dar. Aufgabe der akustischen Phonetik ist es, aus dieser Einzigartigkeit die gemeinsamen Züge herauszuarbeiten, die es dem Hörer erlauben, unterschiedliche Signale als Instanzen ein und desselben Lauts zu identifizieren. Der Begriff „Phon“, der in Phonetik und Phonologie genutzt wird, ist also bereits eine abstrakte Kategorie.

12.3 Auditive und Perzeptive Phonetik

Von „auditiver Phonetik“ („Ohrenphonetik“) wird gesprochen, wenn Phonetiker mit ihrem Gehör arbeiten. Die auditive Phonetik nutzt das Ohr als Instrument, um zum Gegenstand Sprache Zugang zu gewinnen. Sie stellt somit einen Gegenpol zur so genannten instrumentellen Phonetik dar, die die physikalische Grundlage der Höreindrücke apparativ untersucht. Die Ausbildung von Phonetikern umfasst ein langjähriges Training ihrer auditiven Fähigkeiten, zu dem auch der Abgleich von Höreindrücken gehört.

Als perzeptive Phonetik bezeichnet man spezifischer ein Teilgebiet der Phonetik, das die physiologischen Aspekte der Verarbeitung von Schallwellen untersucht. Ihr Gegenstand ist das Ohr, aber auch das Verhältnis von messbaren Charakteristika des Schallsignals und ihrer psychischen Verarbeitung bei der Wahrnehmung. Die Aufnahme und Verarbeitung von Schallwellen durch den menschlichen Hörorganismus ist komplex. Als organische Ausstattung dient das Ohr der räumlichen Orientierung und der Kontrolle des Gleichgewichts. Es ist zudem in der Lage, Schallsignale aufzufangen und Schallquellen im Raum hinsichtlich ihrer Lage zu differenzieren.

Das äußere Ohr dient als Trichter, der eingehende Signale sammelt. Das Trommelfell, eine Membran, die das Mittelohr luftdicht abschließt, registriert diese als Erschütterungen. Durch ein System von Knöchelchen und Knorpeln („Hammer“, „Amboss“ und „Steigbügel“) wird das Signal im Mittelohr mechanisch gebündelt und verstärkt. Das innere Ohr beherbergt das eigentliche Hörorgan, die Schnecke (Cochlea). Sie setzt sich aus mehreren flüssigkeitsgefüllten Schläuchen zusammen, auf denen feine Haarzellen sitzen. Je nach Frequenz werden die Haarzellen an unterschiedlichen Stellen der Schnecke erregt. Die Schwingungen der Haarzellen werden in biochemische und elektrische Impulse umkodiert. Diese werden über das zentrale Nervensystem an das Gehirn übertragen, das die über das rechte und linke Ohr eingehenden Reize verarbeitet. Neuere Perzeptionstheorien gehen davon aus, dass die Verarbeitungsprozesse unter Rückgriff auf neuronale Kodierungen der Sprechbewegungen erfolgen. Vereinfacht ausgedrückt bedeutet dies, dass „Hören“ ein „inneres Sprechen“ umfasst.

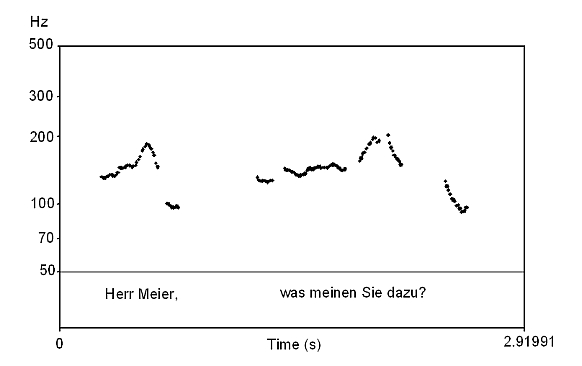

Abb. 5: Logarithmische Darstellung eines Grundfrequenzverlaufs

Das Gehör erfasst verschiedene, vom Schalldruckpegel her als „gleich laut“ gemessene Töne je nach ihrer Frequenzlage unterschiedlich. Auch die Wahrnehmung von Tonhöhe ist variabel: Tiefere Frequenzen können vom menschlichen Ohr differenzierter unterschieden werden als höhere Frequenzen. Während den physikalischen Größen eine lineare Skalierung entspricht, deren Abschnitte jeweils „gleich groß“ sind, entspricht der auditiven Wahrnehmung eine logarithmische Skala mit „unterschiedlich großen“ Abschnitten. Die Zusammenhänge zwischen physikalischen und psychischen Größen werden in der Psychoakustik untersucht.

Im Zusammenhang des Fremd- und Zweitsprachenerwerbs ist insbesondere die Wahrnehmung von phonetischen Charakteristika interessant, die in den Herkunftssprachen von Lernenden keine Funktion besitzen. Für Deutsch als Fremd- und Zweitsprache gibt es bislang allerdings nur sehr wenige perzeptive Untersuchungen.[ 5 ] Die vorhandenen Ergebnisse weisen darauf hin, dass eine zunehmende hörende Diskriminierung phonologisch genutzter Eigenschaften der eigenen Produktionsfähigkeit vorausgeht. In der Didaktik des Deutschen als Fremd- und Zweitsprache wird im Zusammenhang der Ausspracheschulung daher verstärkt auch auf die Hörschulung Wert gelegt.

12.4 Artikulatorische Phonetik

In der artikulatorischen Phonetik wird der Sprechvorgang genauer untersucht. Man beschäftigt sich mit den Muskelbewegungen und Abläufen bei der Lautproduktion.

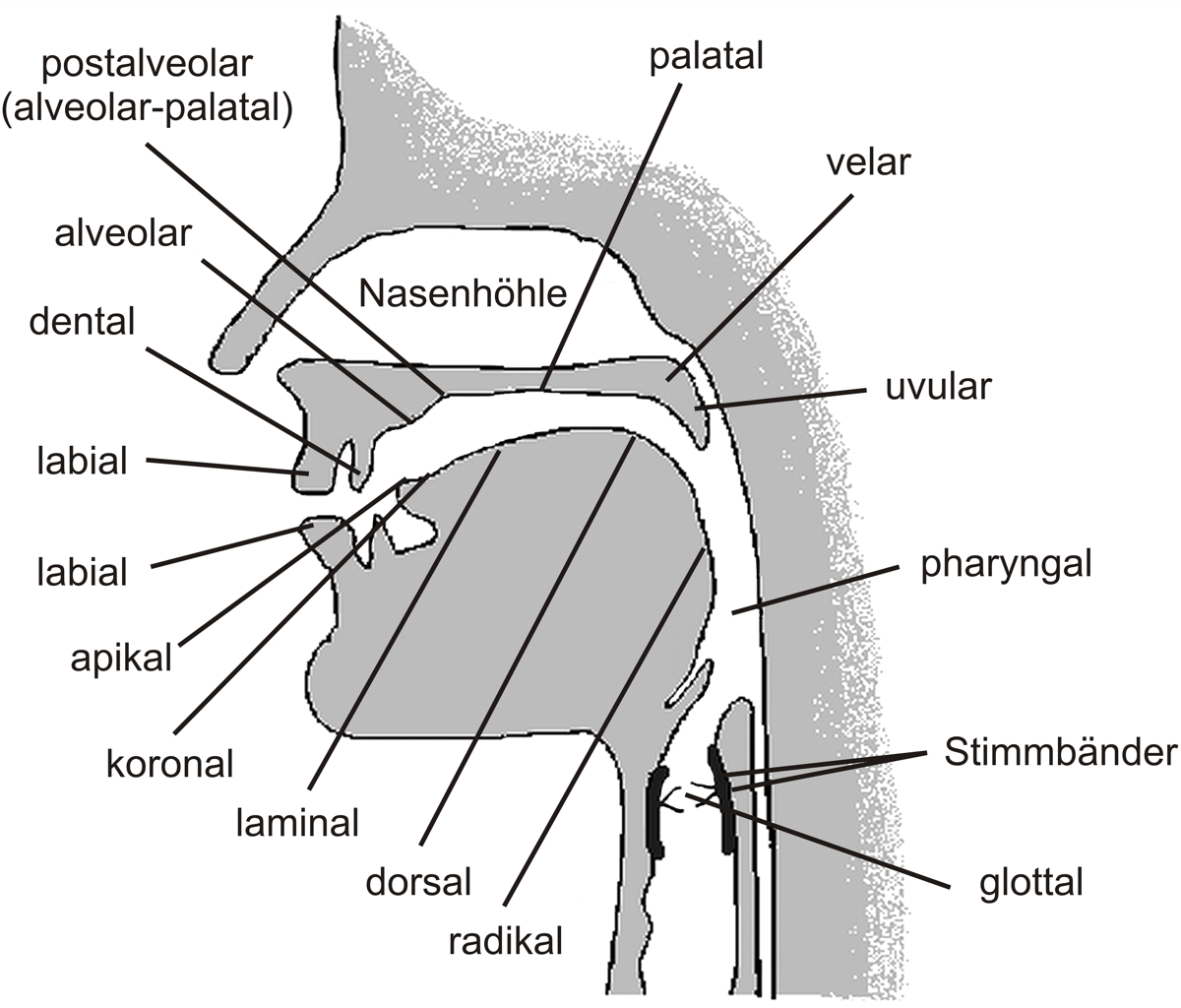

Abb. 6: Artikulierende Organe und Artikulationsstellen

Das Sprechen als Hervorbringung von Luftdruckschwankungen ist eine sekundäre Funktion des Atmens, unter Nutzung der biologischen Werkzeuge für die Nahrungsaufnahme. Luft wird unter Beteiligung von Brust-, Hals-, Schulter-, Rücken- und Bauchmuskulatur eingeatmet und wieder freigegeben.[ 6 ] Beim Sprechen wird der Luftdruck meist mit dem ausgeatmeten Luftstrom manipuliert; in einigen Fällen und Sprachen kann aber auch das Einatmen des Luftstroms zur Hervorbringung von Luftdruckschwankungen genutzt werden. Die Koordination der Sprachproduktion mit dem Atemrhythmus geschieht weitgehend unbewusst.

Der Kehlkopf (Larynx) ist Teil der Atemwege und schützt den Atmungstrakt vor dem Eindringen von Nahrung. In zweiter Linie dient er der Erzeugung von Tönen. Zwischen den Knorpeln des Kehlkopfs spannen sich die Stimmlippen. Sie begrenzen einen Spalt, den man als Glottis (Stimmritze) bezeichnet, und verjüngen sich jeweils zu einem freien Rand (Stimmbänder). Bei der normalen Atmung ist die Glottis weit geöffnet, bei der Phonation hingegen geschlossen. Der nach Sprengung des Glottisverschlusses entweichende Atemstrom versetzt die Stimmbänder in Schwingung. Je nachdem, ob die Stimmbänder voll oder nur teilweise schwingen, entstehen unterschiedliche Resonanzverhältnisse („Brust-,“ „Kopf-“, „Flüster-“ oder „Murmelstimme“). Die Größe der Stimmlippen bestimmt neben sprachlichen Faktoren die individuelle mittlere Sprechstimmlage einer Person.

Die an der Sprachproduktion beteiligten, beweglichen Organe im Mund- und Rachenraum werden als „Artikulationsorgane“ oder „aktive Artikulatoren” bezeichnet. Mit Hilfe der Artikulationsorgane werden unterschiedliche Resonanzräume gebildet, die die Klangcharakteristik des Lautstroms ausmachen. Die jeweiligen Stellen im Mundraum, an denen die Lautbildung stattfindet, werden Artikulationsstellen oder passive Artikulatoren genannt.

Man unterscheidet die folgenden aktiven Artikulatoren und Bezeichnungen:

- die Lippen, labial

- die Zungenspitze (Apex), apikal

- das Zungenblatt, d. h. die Vorderzunge (Lamina), laminal

- den Zungenkranz (Korona), koronal

- den Zungenrücken (Dorsum), dorsal

- die Zungenwurzel (Radix), radikal

- die Stimmbänder

Als Artikulationsstellen (passive Artikulatoren) werden differenziert:

- die Oberlippe, labial

- die Oberzähne, dental

- das Zahnfach des Kiefers (Alveolen), alveolar

- der harte Gaumen (Palatum), palatal

- das Gaumensegel (weicher Gaumen, Velum), velar

- das Zäpfchen (Uvula), uvular

- die Rachenwand (der Rachen, Pharynx), pharyngal

- die Stimmritze im Kehlkopf, glottal bzw. laryngal

Bei dem Laut [m] wie in Mama nähert sich z. B. die Unterlippe der Oberlippe; er wird – da beide Lippen beteiligt sind – als labio-labial oder als bilabialer Laut klassifiziert. Bei [f] wie in Foto hingegen nähert sich die Unterlippe den Schneidezähnen; der Laut wird als labio-dental bezeichnet. Durch Kontakt der Zunge mit den Alveolen gebildet Laute wie [n] in nein und [t] in Tag bezeichnet man als apiko-alveolar bzw. lamino-alveolar [ 7 ], durch Kontakt des Zungenrückens mit dem Velum gebildete Laute wie [k] in Kuchen hingegen als dorso-velar. Glottal gebildete Laute sind im Deutschen [h] wie in Haus sowie der „Knacklaut“ [Ɂ] wie in aus (vgl. Kap. 13).

Da der aktive Artikulator und die jeweilige Artikulationsstelle eng zusammenhängen (so sind z. B. labio-uvulare Laute artikulationstechnisch ausgeschlossen), beschränkt man sich bei der Lautklassifikation häufig darauf, nur die Artikulationsstelle zu benennen. Insbesondere bei sprachvergleichenden Betrachtungen kann sich aber eine Angabe auch der aktiven Artikulatoren als sinnvoll erweisen.

Bei der Beschreibung der Sprachlaute werden Bewegungsabläufe als „Eigenschaften“ von Lauten erfasst. Ausgehend von der Art und Weise der Modifikation des Luftstroms (Artikulationsart, Artikulationsmodus) werden unterschiedliche Typen von Lauten unterschieden. Anhand der Aktivität der Stimmlippen werden stimmhafte und stimmlose Laute differenziert. Bei stimmhaften Lauten (z. B. [a], [m], [d]) ist eine Vibration der Stimmbänder zu verzeichnen, bei stimmlosen Lauten (z. B. [t], [f], [s]) hingegen nicht.

Je nach Stärke der Behinderung des Luftstroms unterscheidet man zwischen vokalischen und konsonantischen Lauten. Bei der Artikulation von Vokalen kann der Luftstrom den Mundraum relativ ungehindert verlassen. Die Artikulatoren formen dabei verschiedene Resonanzräume. Durch den Grad der Mundöffnung, die jeweilige Zungenstellung (Hebung der Vorder- oder Hinterzunge), Kieferstellung und Lippenform (z. B. gerundet, gespreizt) ergibt sich die spezifische Klangfarbe eines Vokals. So unterscheidet sich [i] von [a] beispielsweise durch die geringere Mundöffnung und Hebung der Vorderzunge. Bei Lauten wie [u] und [o], auch bei [y] (ü) und [ø] (ö), sind die Lippen gerundet. Unter den Vokalen finden sich einfache Laute (Monophthonge), z. B. [a], [i], [u], und Doppellaute (Diphthonge), z. B. [aʊ] (au), [aɪ] (ei) oder [ɔɪ] (eu). Diphthonge sind durch eine Bewegung der Zunge von einer Ausgangs- auf eine folgende Artikulationsposition gekennzeichnet, wobei einer der beiden Laute kürzer artikuliert wird und keine silbische Qualität besitzt (vgl. Kap. 13). Der kürzer gesprochene Teil wird auch als „Gleitlaut“ bezeichnet und zum Teil als solcher in Notationen gekennzeichnet.[ 8 ] Werden hingegen zwei Vollvokale hintereinander gesprochen (wie z. B. in Pinie, Kastanie, Ethnie), nennt man dies einen „Hiatus“.

Im Unterschied zu den Vokalen wird der Luftstrom bei der der Artikulation von Konsonanten stark manipuliert. Ausgehend von der Art der Behinderung werden verschiedene Typen von Konsonanten unterschieden:

Plosive (Verschlusslaute), z. B. [p], [t], [d], kommen dadurch zustande, dass ein Verschluss gebildet und anschließend wieder gelöst wird. Die Lösung kann entweder nach außen (Explosiv) oder nach innen gerichtet sein (Implosiv).[ 9 ] Je nach Beteiligung der Stimmbänder unterscheidet man stimmlose (z. B. [p], [t], [k]) und stimmhafte Plosive, z. B. ([b], [d], [g]). Frikative (Reibelaute), z. B. [f], [v], [s], kommen durch Engebildungen zustande. Der Luftstrom wird zwischen zwei Hindernissen hindurchgepresst, wodurch sich das jeweilige „Reibegeräusch“ ergibt. Auch Frikative können stimmlos (z. B. [f], [s], [χ]) oder stimmhaft sein, z. B. ([v], [z], [ʁ]). Plosive und Frikative werden auch unter der Bezeichnung „Obstruenten“ zusammengefasst.

Den Obstruenten lassen sich die „Sonoranten“ gegenüberstellen. Mit dem Begriff werden drei Lautgruppen zusammengefasst, für die als artikulatorisches Merkmal Stimmhaftigkeit kennzeichnend ist. Nasale (Nasallaute), z. B. [m], [n], sind durch die Lenkung des Luftstroms durch die Nase gekennzeichnet. Laterale Laute, z. B. [l], sind dadurch gekennzeichnet, dass die Luft seitlich aus dem Mund entweicht. Zudem gibt es einige konsonantische Laute, die einen fließenden Übergang zu den Vokalen aufweisen, z. B. [j]. Sie werden als Approximanten bezeichnet.

Artikulationsbewegungen lassen sich durch instrumentalphonetische Verfahren genauer erfassen. Bereits früh wurden in der experimentellen Phonetik Röntgenstrahlen zur empirischen Untersuchung der Artikulation benutzt. Neuere Verfahren sind die Photoelektroglottographie, durch die Bewegungen des Kehlkopfs gemessen werden, die Elektropalatographie, die den Zungen-Gaumen-Kontakt erfasst, und der Einsatz von Ultraschall (Sonographie).

Die apparativen Möglichkeiten besitzen für die Forschung großen Wert, sind für die praktische Fremdsprachenlehre jedoch wenig nützlich. So ist bislang kaum vorstellbar, dass ein Sprachlerner bei Übungen Kiefereinlagen mit Elektroden benutzt. Für den Ausspracheunterricht stellt sich vielmehr die Frage, in welchem Ausmaß sich die Sprachlernenden artikulatorischer Vorgänge bewusst sind. Einige Laute (z. B. Lippenlaute) lassen sich relativ leicht in ihrer Motorik „erleben“; andere hingegen (z. B. Rachenlaute) sind der individuellen Körperbewusstheit weniger gut zugänglich.[ 10 ]

12.5 IPA

Ein wichtiges Hilfsmittel der Beschreibung von Sprachlauten stellt das Internationale Phonetische Alphabet (IPA) bereit, dessen Notationssymbole auch zur Erfassung des Deutschen genutzt werden (vgl. Kap. 13). IPA wurde Ende des 19. Jahrhunderts vom Weltlautschriftverband (International Phonetic Association) vor dem Hintergrund fremdsprachendidaktischer Überlegungen entwickelt und wird seitdem kontinuierlich überarbeitet. Das Alphabet eröffnet die Möglichkeit, verschiedene Sprachen durch ein von diesen unabhängiges Schriftsystem zu erfassen. Es nutzt ein 1:1-Prinzip von Laut und Schreibung und gilt daher als phonographisches Schriftverfahren „par excellence“. Viele IPA-Zeichen sind der lateinischen Buchstabenschrift entnommen. Zudem wurden weitere Zeichen aus anderen Schriftsystemen (z. B. dem Griechischen) eingefügt und Sonderzeichen entwickelt. In der zweiten Hälfte des 20. Jahrhunderts fand IPA breiten Eingang in die Praxis des fremdsprachlichen Unterrichts und in Wörterbücher. Eine phonetische Schreibung wird durch eckige Klammern gekennzeichnet, z. B. [zoː].

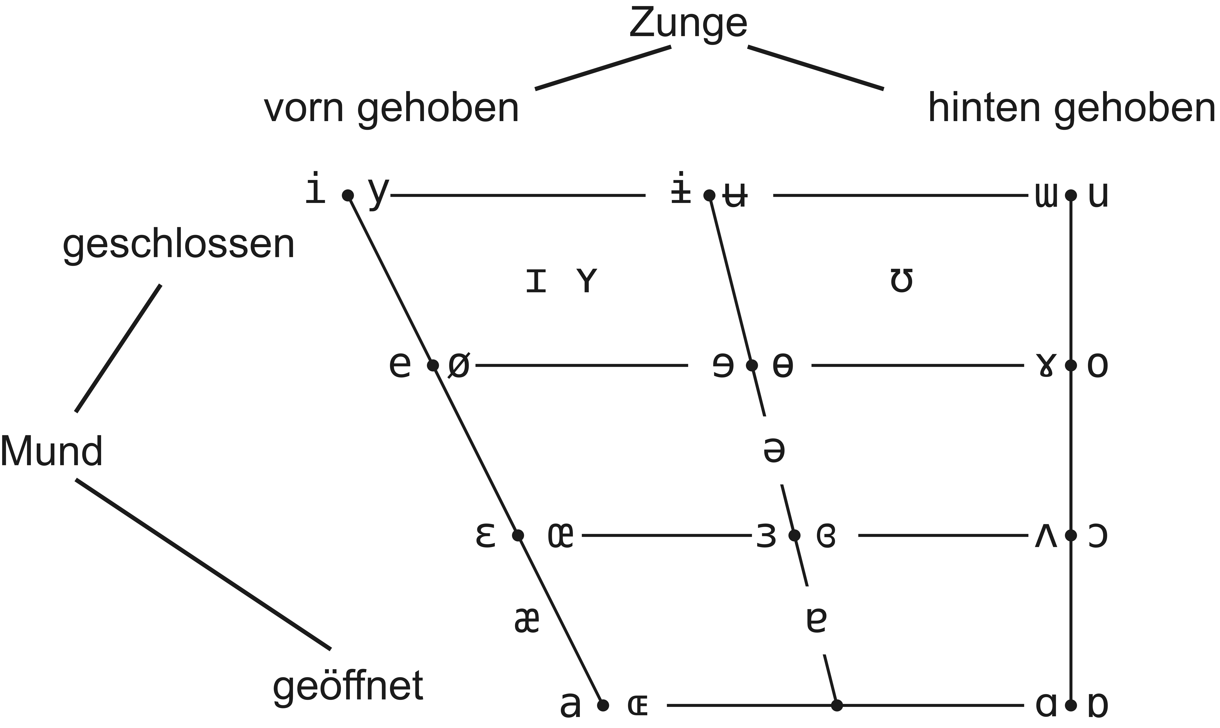

Bei der Notation von Vokalen bezieht man sich in IPA auf künstlich festgelegte Laute (Kardinalvokale), die durch bestimmte Kiefer- und Zungenstellungen charakterisiert sind. Sie lassen sich in einem Vokaltrapez erfassen, das drei Dimensionen abbildet:

- die Zungenstellung (Hebung vorn – Mitte – hinten)

- die Mund- bzw. Kiefernstellung (offen – geschlossen)

- die Lippenstellung (1. Eintrag – nicht gerundet, 2. Eintrag – gerundet)

Abb. 7: Vokaltrapez (IPA)

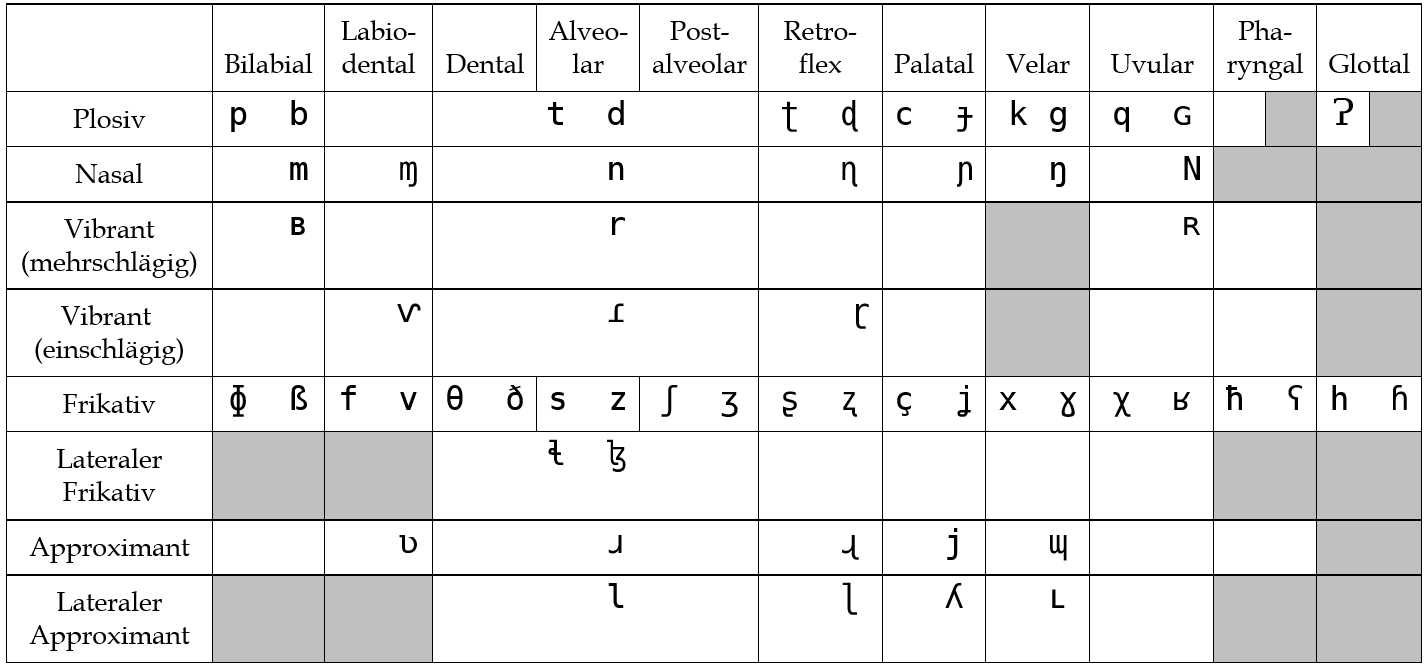

Die Erfassung von Konsonanten erfolgt in IPA als Kreuzklassifikation anhand der beteiligten Artikulatoren und der Bildeweise (s. Tab. 1). Die einzelnen Felder bieten Symbole für verschiedene Laute, auf die die jeweiligen Charakteristika zutreffen. Sie enthalten oft zwei Einträge, die sich auf die Unterscheidung von stimmlosen Lauten (1. Eintrag im jeweiligen Feld) und stimmhaften Lauten (2. Feldeintrag) beziehen. Dunkle Feldschraffierungen beziehen sich auf artikulatorisch ausgeschlossene Kombinationen.

Tab. 1: Konsonanten (IPA)

IPA stellt zudem eine Reihe von Sonderzeichen und Diakritika bereit. Sie werden im Rahmen von engen phonetischen Transkriptionen verwendet. Eine Übersicht über einige Sonderzeichen findet sich in den digitalen Materialien. Zudem gibt es noch ein eigenes IPA-Zeichenrepertoire zur Notation „verzerrter Sprache“ (distorted speech).

Sprachen können sich hinsichlich der in ihnen vorkommenden Sprachlaute erheblich unterscheiden. Die Vielzahl und Auswahl der Laute in verschiedenen Sprachen der Welt beschreiben Ladefoged / Maddieson (1996). In den Bantu-Sprachen beispielsweise finden sich so genannte „Klick-Laute“, die dem deutschen System völlig fremd sind. Deutsch wiederum macht von einer Vielzahl von Reibelauten Gebrauch, von denen sich einige in anderen Sprachen selten oder gar nicht finden (vgl. Kap. 13).

Für die Fremdsprachenlehre ist die Phonetik von besonderem Interesse. Fremdsprachensprecher fallen oft in der phonetischen Dimension auf: Ihre Aussprache klingt „anders“ als die von Sprechern, die die betreffende Sprache als Erstsprache erworben haben; sie sprechen „mit Akzent“.[ 11 ] Beim Erlernen der Fremdsprache gilt es unter Umständen, motorische Gewohnheiten zu ändern und neue Artikulationsabläufe zu erlernen. Für die praktische Aussprachelehre ebenso wie die sprachkontrastive Grundlagenforschung ist es daher wichtig zu wissen, welche Momente bei der Produktion eine Rolle spielen und welche Untersuchungs- und Beschreibungsmöglichkeiten die Phonetik bereitstellt, um Sprachunterschiede und lernersprachliche Aussprachen zu erfassen.

Im Fremd- und Zweitsprachenunterricht ist der Rückgriff auf das Internationale Phonetische Alphabet hilfreich, um Ausspracheunterschiede zwischen Zielsprache und bisher erlernten Sprachen bewusst zu machen. Zudem kann das Wissen um Artikulatoren, Artikulationsorte und Bildeweisen die eigene Produktion erleichtern. Auch im erstsprachlichen Unterricht erweist sich IPA als nützlich, um das Verhältnis von Laut und Schrift verständlich zu machen und Rechtschreibschwierigkeiten zu erkennen.

Zur phonetischen Schreibung der standarddeutschen Aussprache werden nicht alle im IPA-Inventar aufgeführten Zeichen benötigt. Will man jedoch regionale Formen und Varianten erfassen, muss auf weitere IPA-Symbole und Sonderzeichen zurückgegriffen werden.

Das Lautsystem des (Standard-)Deutschen wird im folgenden Kapitel näher dargestellt. Einige Übungen, die mit den phonetischen Begriffen und Schriftzeichen vertraut machen, finden sich in den digitalen Materialien.

[ 1 ]Das Programm wurde von Paul Boersma und David Weenik an der Universität Amsterdam entwickelt (s. Internet-Einstiege).

[ 2 ]Vgl. ausführlicher Reetz (2003).

[ 3 ]Zur Wahrnehmung von Lautheit s. Kap. 12.3.

[ 4 ]Angaben nach Pompino-Marschall (2011).

[ 5 ]Eine der wenigen Arbeiten ist van Dommelen (1980).

[ 6 ]Zu den zahlreichen, am Sprechen beteiligten Muskeln s. ausführlich Pompino-Marschall (2011).

[ 7 ]Apikal und laminal gebildete Laute werden auch unter der Bezeichnung „Koronallaute“ zusammengefasst, vgl. Pompino-Marschall (2009, S. 187).

[ 8 ]Entweder geschieht dies durch Notation als „nicht-silbischer Vokal“ (mittels Subskript [̯ ]) oder durch Notation von Bindung (mittels Verbindungsbogen [̮ ]).

[ 9 ]Implosive kommen z. B. in afrikanischen und asiatischen Sprachen vor.

[ 10 ]Ein Beispiel ist der deutsche uvulare Reibelaut [ʁ] (r), der z. B. durch Gurgeln eingeübt werden kann.

[ 11 ]In diesem Zusammenhang spricht man auch von „Akzentsprache“, wobei dieser Begriff nicht nur auf fremd- und zweitsprachliche, sondern auch auf dialektal-regional oder physiologisch bedingte Abweichungen von der Standardaussprache bezogen wird. Zu unterscheiden ist davon der Begriff „Akzent“ zur Bezeichnung von Betontheit einer Silbe („Wortakzent“, „Satzakzent“, s. Kap. 14).